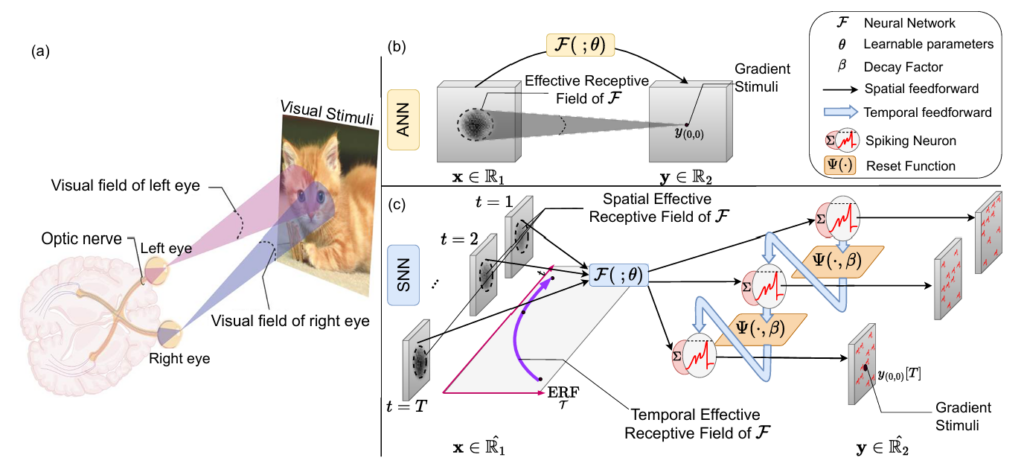

저번 월요일에는 한용옥 연구원이 Spiking Transformer에서 receptive field가 어떻게 형성되는지를 연구하고 이를 ANN version transformer와 비교하여 기존의 spiking transformer에서 생기는 학습 성능 저하 문제를 해결하고자 하는 논문을 발표하였습니다. 해당 논문에서는 입력 데이터를 기준으로 출력에 큰 영향을 미치는 부분들을 뽑아낸 receptive field를 분석하였고 Spikinv Transformer에서 해당 영역이 ANN version 대비 매우 작은 것을 확인하였습니다. 이러한 문제는 Spiking Transformer의 특징 추출 과정에서 latent가 LIF neuron의 필터 성질로 인해 일부 소실되는 것에서 비롯하였으며 이를 해결하기 위해 MLP mixer layer를 도입하였고 Spiking Transformer의 성능을 높이는 것에 성공하였습니다. 간단한 방법으로 Spiking Transformer의 성능을 높이는 것은 좋았으나 왜 MLP를 단순히 끼워넣는 것 만으로 이러한 해결책이 도출되었을 수 있는지에 대한 더 자세한 설명이 있으면 좋을 것 같습니다.