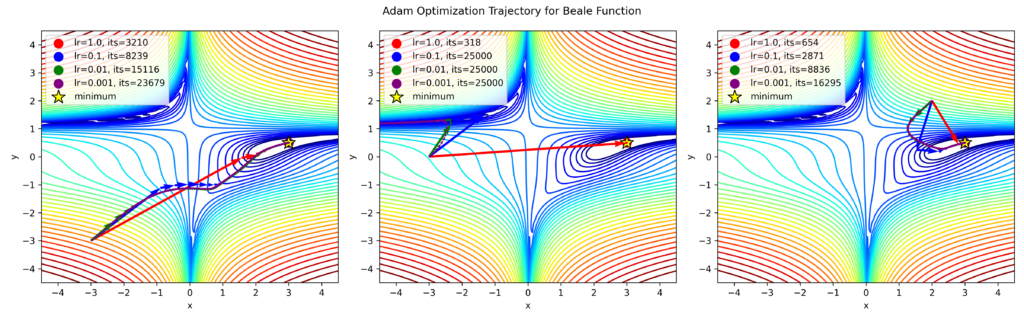

오늘은 허정윤 연구원이 딥러닝 모델 훈련에 많이 쓰이는 Adam optimizer가 기존의 Stochastic Gradient Descent (SGD)로부터 어떻게 발전되었는지에 대해 다루는 세미나를 진행하였습니다. 기존의 SGD는 훈련 도중 지역 해에 빠지게 된 후 weight가 이 지역해에서 빠져나오지 못하고 그 상태에 머무르고 있는 것이 큰 문제였습니다. 이런 문제를 해결하기 위해 과학자들은 물리학에서 쓰이는 momentum의 개념을 적용하여 이러한 지역 해를 쉽게 빠져나오고 전역해 혹은 전역 해에 최대한 가까운 지역 해에 가중치가 수렴될 수 있도록 하는 방법을 개발했고 이를 바탕으로 Adam optimizer를 만들었습니다. 이 세미나를 듣기 전에는 그냥 Adam이 성능이 좋으니까 쓰는 거겠지라고 생각하며 큰 생각 없이 Adam을 신경망 구조 훈련에 사용하였으나 향후 optimizer를 선택하는데 있어서는 여러 optimizer의 특성을 반영하여 올바른 optimizer를 제대로 고를 수 있도록 여러 고찰을 해볼 수 있는 시간을 가지면 좋을 것 같습니다.