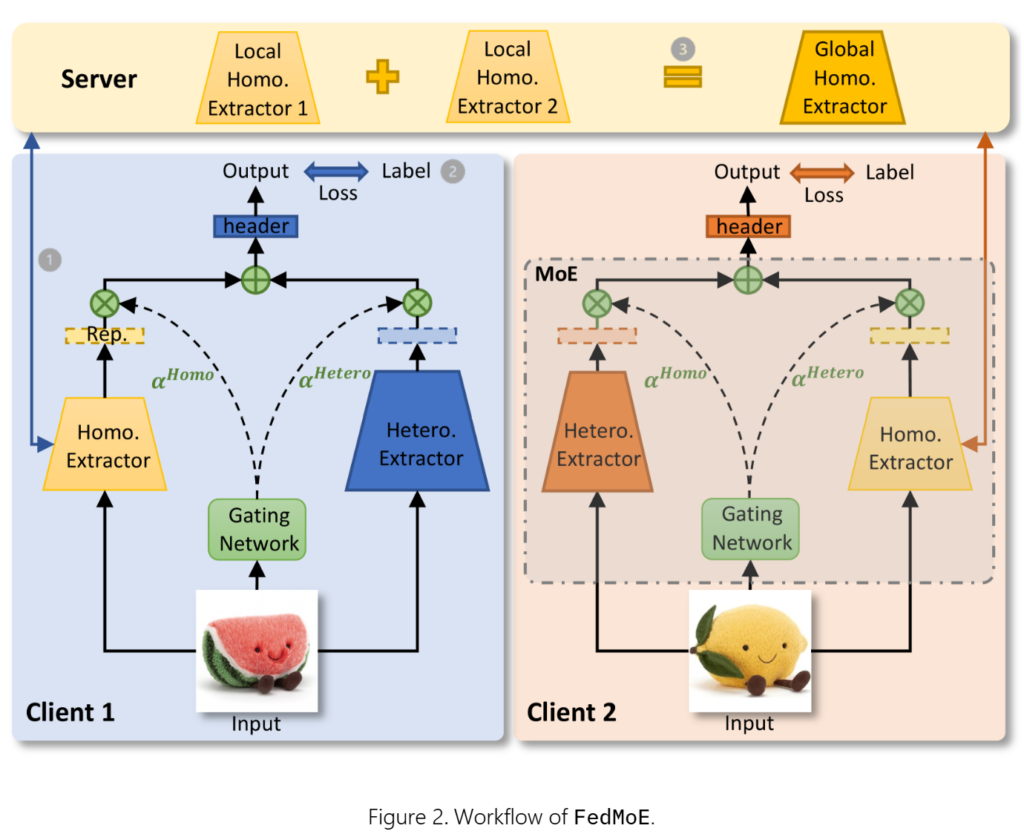

이번주 화요일에는 한용옥 학생이 MoE를 이용한 연합 학습 방식을 다룬 논문을 소개했습니다. MoE는 Mixture of Experts의 약자로 전체 신경망 모델에 대한 입력 데이터에 대해 특화된 작은 전문가 모델을 여러 개 두고 입력 데이터에 따라 적절한 전문가 모델을 사용해 최적의 출력 결과를 얻는 신경망 디자인 방식입니다. 저자들은 federated learning을 위한 모델에 두 개의 전문가인 homo-extractor와 hetero-extractor를 이용해서 연합 학습에서 서버에 필요한 데이터 feature들과 각 client들에 필요한 데이터 feature들을 추출할 수 있도록 하고 이를 가중치의 형태로 저장할 수 있도록 했습니다. 이런 구조를 통해 연합 학습의 학습 능력을 효율적으로 향상 시킨 점을 확인 할 수 있었으며, 현재 진행 중인 저희 연구에도 다양하게 활용할 수 있을 것 같습니다.