오늘은 김동균 연구원이 현재 많이 연구되고 있는 주제인 연합학습에 대한 논문을 발표했습니다.

현재 연합학습은 다수의 저사양 모바일 기기를 이용해 전체 신경망 중 일부 네트워크의 가중치를 학습한 뒤 이를 중앙 서버에 보내서 통합하는 과정을 거치고 다시 각각 모바일 기기들에 자신들이 담당하던 네트워크 부분의 가중치를 할당해주는 과정을 통해 이뤄지고 있습니다.

이 과정에서 각 모바일 기기에 들어오는 데이터 샘플의 분포가 학습 성능에 큰 영향을 끼치고 있습니다.

IID한 분포를 가지는 데이터들일 경우 이는 큰 문제가 되지 않지만 Non-IID한 분포를 데이터들이 가질 경우 성능에 악영향을 끼칠 수 있습니다.

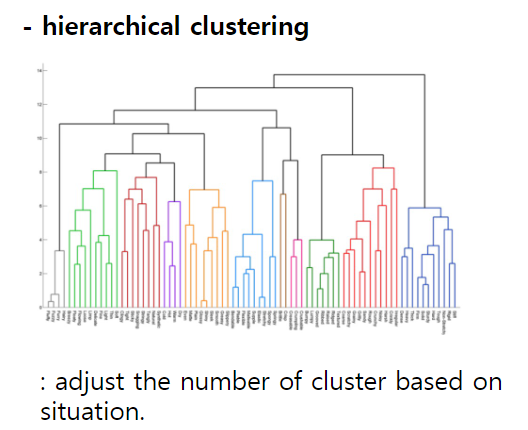

이 Non-IID 문제를 해결하기 위해 해당 논문에서는 계층적 클러스터링을 이용해서 비슷한 데이터끼리 묶어서 하나의 클러스터를 만들고 해당 클러스터 내의 데이터 샘플들을 이용해서 연합학습을 진행한 뒤 이를 통해 실험 결과를 얻어냈습니다.

이를 통해 기존의 연합학습 성능보다 더 높은 성능을 얻어냈지만 각 클러스터 내의 가중치들이 중앙 서버에서 어떻게 통합되고 이 통합된 가중치들이 어떻게 원래 클러스터로 다시 할당되는지의 과정이 좀 더 명확하게 드러나 있으면 더 좋은 매커니즘이 될 수 있을 것 같습니다.