저번 주 금요일에는 탁동혁 연구원이 굉장히 유명한 논문인 attention is all you need 논문을 발표하였습니다.

현재 학계에서 어텐션 기법과 이를 기반으로 하는 트랜스포머는 굉장히 각광 받고 있는 기법이며 ChatGPT를 만드는데 큰 공현을 한 것으로 알려져 있습니다.

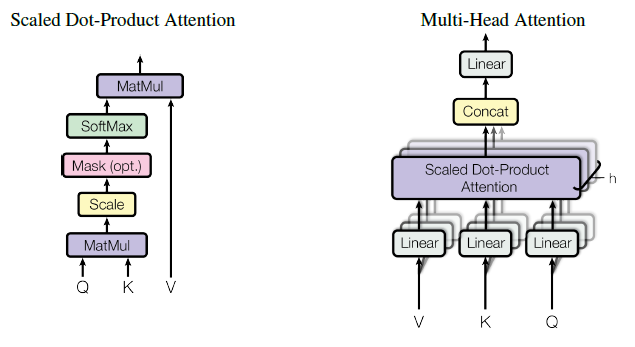

일반적인 Attention과 Multi-head Attention 비교

어텐션 기법은 어떠한 예측값을 만들어 내는데 매우 중요한 역할을 하는 데이터에 어텐션 점수를 부여하여 이 점수가 높은 데이터에 신경망이 집중할 수 있도록 하는 방법입니다.

기존의 신경망에 비해 언어 번역에 있어서 더 좋은 성능을 보였으며 현재는 자연어 처리 뿐만이 아니라 자율주행 자동차 궤적 예측과 같이 다른 도메인에서 널리 쓰이고 있습니다.

해당 기법을 좀 더 깊이 파봐서 현재 탁동혁 연구원이 만들고 있는 자율주행 자동차 궤적 예측 시스템을 더 개량할 수 있을 것 같습니다.